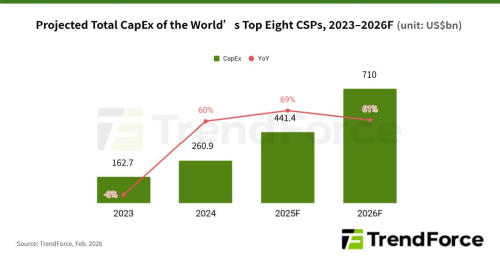

Спрос на услуги доступа к моделям искусственного интеллекта (которые слишком велики и ресурсоёмки для локального исполнения, и потому доступ к ним предоставляется заказчикам как облачный сервис) по-прежнему не просто велик, но продолжает расти, и объективных пределов этому росту пока не видно. Естественный сдерживающий фактор здесь — ограниченность серверных мощностей, которыми располагают глобальные поставщики облачных услуг (гиперскейлеры). И те, видя чрезвычайно благоприятную для себя конъюнктуру, за ценой совершенно определённо не стоят: согласно оценке экспертов TrendForce, по итогам 2026 г. совокупные — только капитальные, без учёта операционных — затраты восьми лидирующих гиперскейлеров мира (а это Google, AWS, признанная в России экстремистской Meta, Microsoft, Oracle, Tencent, Alibaba и Baidu) взлетят сразу на 61% от прошлогоднего уровня, превысив 710 млрд долл. США.

Капитальные затраты восьми ведущих гиперскейлеров мира по годам, столбцы, млрд долл. США, и их годовая динамика, линия, %

Источник: TrendForce

Главные статьи расходов этих крупнейших заказчиков ИТ-оборудования, как и следовало ожидать, — серверные ускорители Nvidia и, в значительно меньшей степени, AMD. Вместе с тем аналитики подмечают тенденцию к более широкому применению специализированных для ИИ-вычислений микросхем собственной разработки облачных провайдеров. Дизайном этих чипов обычно занимаются соответствующие подразделения в структурах гиперскейлеров либо их материнских компаний, а изготовлением — по большей части всё та же тайваньская TSMC, что обеспечивает выпуск и графических процессоров Nvidia с AMD.

Так, семейство тензорных процессоров TPU, разрабатываемых в Alphabet, материнской компании Google, в 2026 г. обновится в очередной раз, — до версии v8. Эксперты ожидают, что 78% всех ИИ-серверов, которые Google закупит за текущий год, будут оснащаться именно этими TPU, а не ГП сторонних компаний. Для Amazon доля новых ИИ-серверов на процессорах Trainium внутренней разработки в 2026 г. достигнет 40%; для других гиперскейлеров, позже обративших внимание на такого рода чипы, — 20% и меньше.

Преимущества специализированных вычислителей для решения ИИ-задач, менее универсальных по сравнению с продуктами лидера этого сегмента ИТ-рынка, Nvidia, — в их повышенной энергоэффективности (как раз за счёт специализации) и потенциально сниженной себестоимости. Потенциально — потому, что заказанные на стороне заведомо малыми партиями чипы внутренней разработки и для внутреннего же потребления обходятся клиентам не слишком дёшево, тогда как у поставленных на поток процессоров Nvidia — рынок сбыта которых огромен — удельные накладные расходы при производстве ниже.

И всё-таки, поскольку Nvidia, пользуясь своим доминирующим положением, проводит не самую дружественную к заказчикам ценовую политику, более твёрдая ставка на собственные чипы для гиперскейлеров имеет смысл уже в среднесрочной перспективе.