Рынок железа меняется на фоне массового внедрения AI. Компании все чаще используют машинное обучение в продуктах и внутренних процессах. В ответ вендоры перестают делать универсальные решения и проектируют GPU под конкретные AI-нагрузки. Например, в 2025 году специализированные решения представили как крупные западные производители — Intel и AMD, — так и китайские компании вроде Baidu и Huawei.

Вместе с Selectel, ведущим независимым провайдером IT-инфраструктуры и серверов с GPU, решили разобрать наиболее интересные серверные видеокарты и архитектурные подходы 2025 года. К чему стоит присмотреться и какие тренды видны в начале 2026 г. — рассказываем в статье, в ней будут рассмотрены вопросы альтернативных архитектур, экспансии китайских GPU и отход от универсальности видеокарт.

NVIDIA

В 2025 г. NVIDIA представила свою флагманскую DGX B300, продолжающую развитие архитектуры Blackwell. По совокупности характеристик это одно из самых производительных решений года.

Ключевые параметры:

● объем видеопамяти — до 288 ГБ, что позволяет размещать большие модели на одном ускорителе либо эффективно масштабироваться в кластере;

● пропускная способность памяти — до 4,1 ТБ/с, что напрямую влияет на скорость обучения и инференса современных LLM;

● заявленный прирост производительности относительно B200 — от 1,5 до 2 раз в зависимости от типа нагрузки.

Как и предыдущие поколения, B300 не всегда применяется в одиночных конфигурациях. Его можно использовать и в крупных вычислительных системах для распределенного обучения и инференса. Типичный пример — комплекс GB300 NVL72 для работы с экстремально большими моделями, объединяющий 72 ускорителя B300.

Отдельного внимания заслуживает и NVIDIA RTX Pro 6000 Blackwell Server Edition, анонсированная весной. Этот ускоритель хорошо подходит для инференса и показывает высокую производительность за свою цену. Пожалуй, это одна из самых универсальных серверных GPU своего поколения.

Основные особенности:

● ориентация на инференс и дообучение AI-моделей;

● возможность использования в задачах профессиональной визуализации, рендеринга, CAD/CAE, цифровых двойников, симуляций, VDI и GPU-виртуализации;

● архитектура Blackwell с оптимизациями под AI и высокой вычислительной плотностью;

● 96 ГБ GDDR6 с ECC — значительный шаг вперед по сравнению с предыдущими поколениями RTX, упрощающий работу с крупными моделями и сложными сценами;

● поддержка MIG и vGPU, что делает карту удобной для облачных и мультиарендных сред и позволяет «разбить» ее на четыре виртуальных ускорителя.

Важно и позиционирование продукта. RTX Pro 6000 Server Edition — это не упрощенная версия дата-центровых ускорителей и не просто серверный вариант workstation-карты. NVIDIA предлагает универсальный инструмент: одна GPU, способная закрывать широкий спектр задач без необходимости комбинировать разные типы ускорителей.

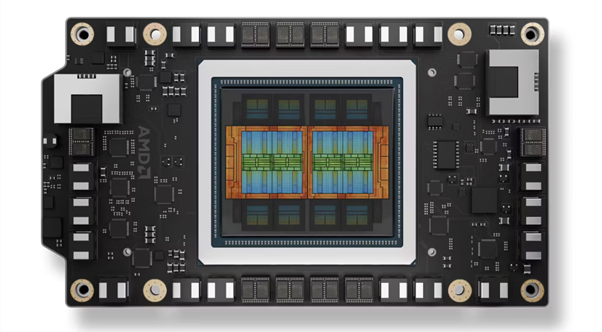

AMD

В 2025 г. компания AMD презентовала новое поколение флагманских ускорителей — Instinct MI350X и MI355X. Эти решения напрямую конкурируют с флагманскими продуктами NVIDIA, в том числе с B300.

Главные характеристики:

● архитектура CDNA 4 с поддержкой форматов FP4, FP6, FP8 и FP16;

● до 288 ГБ памяти HBM3E с пропускной способностью до 8 ТБ/с;

● форм-фактор OAM, рассчитанный на платформы с восемью ускорителями в одном узле.

Линейка четко разделена по сценариям. MI350X позиционируется как универсальный ускоритель для обучения и инференса, а MI355X ориентирован на максимальную производительность в плотных вычислительных конфигурациях и масштабируемых кластерах.

Существенный прогресс показала и программная экосистема ROCm. Если ранее именно ПО ограничивало позиции AMD в AI-сегменте, то к 2025 г. ситуация улучшилась: появилась стабильная поддержка PyTorch и TensorFlow, оптимизации под LLM и инференс, а также активное развитие open-source-инструментов.

Хотя ROCm все еще уступает CUDA по зрелости и количеству готовых решений «из коробки», разрыв между экосистемами быстро сокращается, особенно в корпоративных и исследовательских сценариях.

Ключевые тренды

Осенью 2025 г. NVIDIA обозначила важный тренд в развитии GPU — отказ от универсальных ускорителей. Первым проявлением этого тренда стали отдельные чипы для разных фаз инференса LLM.

Современный инференс состоит из двух этапов. Prefill — высокая вычислительная нагрузка при относительно низких требованиях к памяти. И decode — минимальные вычисления, но максимальные требования к объему и пропускной способности памяти.

Ранее оба этапа выполнялись на одном ускорителе, что приводило к неэффективному использованию ресурсов. Новый подход предполагает разделение ролей:

● GPU для decode — максимум HBM и пропускной способности;

● GPU для prefill — максимум FLOPS и более доступная память.

Согласно планам NVIDIA на 2026–2027 гг., серия Rubin включает:

● CPX — ускорители для prefill;

● VR200 — решения для decode;

● VR300 Ultra — до 66,7 PFLOPS и 1 ТБ памяти HBM4E.

Таким образом, NVIDIA перестраивает свои линейки под узкоспециализированные сценарии инференса, постепенно уходя от универсальных GPU.

Похожей стратегии придерживается и корпорация Intel, которая представила Crescent Island — специализированный ускоритель исключительно для AI-инференса. Устройство оснащено 160 ГБ LPDDR5X и ориентировано на сервисы формата tokens-as-a-service. В данном случае ставка делается на большой объем недорогой памяти и минимальные требования к инфраструктуре.

Альтернативные архитектуры

Компания NextSilicon предложила новый подход, представив Maverick-2 — DataFlow-ускоритель, который не вписывается в традиционные рамки стандартных CPU или GPU. Его архитектура основана на массиве реконфигурируемых ALU, способных динамически перестраивать вычислительную топологию под конкретную задачу.

Чип автоматически выявляет узкие места, дублирует операции, меняет режимы вычислений и оптимизирует выполнение без необходимости изменения программного кода. Цель — приблизиться к производительности ASIC, сохранив гибкость, присущую GPU-решениям. В отличие от стратегии NVIDIA и Intel, основанной на специализации этапов вычислений, подход NextSilicon предполагает пересмотр самой концепции ускорителей.

Еще один тренд 2025 г. — активное развитие китайских GPU. В течение года собственные решения представили Baidu, Huawei и Innosilicon:

● Baidu Kunlun M100 и M300;

● Huawei Atlas 300I Duo;

● Innosilicon Fenghua 3;

● Huawei Ascend 910D, Ascend 920 и 920C.

Таким образом, китайские производители последовательно снижают зависимость от зарубежных вендоров и стремятся обеспечить внутренний рынок собственными аппаратными платформами для AI.

Что специализированные GPU означают для бизнеса

Отказ от универсальных видеокарт в пользу узкоспециализированных чипов открывает новую возможность для бизнеса, который арендует мощности — строить по-настоящему рентабельные ИИ-сервисы:

● гибко подбирать инфраструктуру под конкретный тип нагрузки — обучение, fine-tuning, инференс

● оптимизировать затраты, что особенно важно при повсеместном внедрении инференса.

Правильная комбинация «тяжелых» и «легких» GPU для инференса и дообучения моделей позволяет выстроить оптимальную сбалансированную IaaS-архитектуру и эффективнее решать задачи в мире искусственного интеллекта.